در حال خواندن: حمایت گوگل، سونی و اوکتا از سرمایه گذاری روی آشکار ساز دیپ فیک ها

1

-

01

حمایت گوگل، سونی و اوکتا از سرمایه گذاری روی آشکار ساز دیپ فیک ها

حمایت گوگل، سونی و اوکتا از سرمایه گذاری روی آشکار ساز دیپ فیک ها

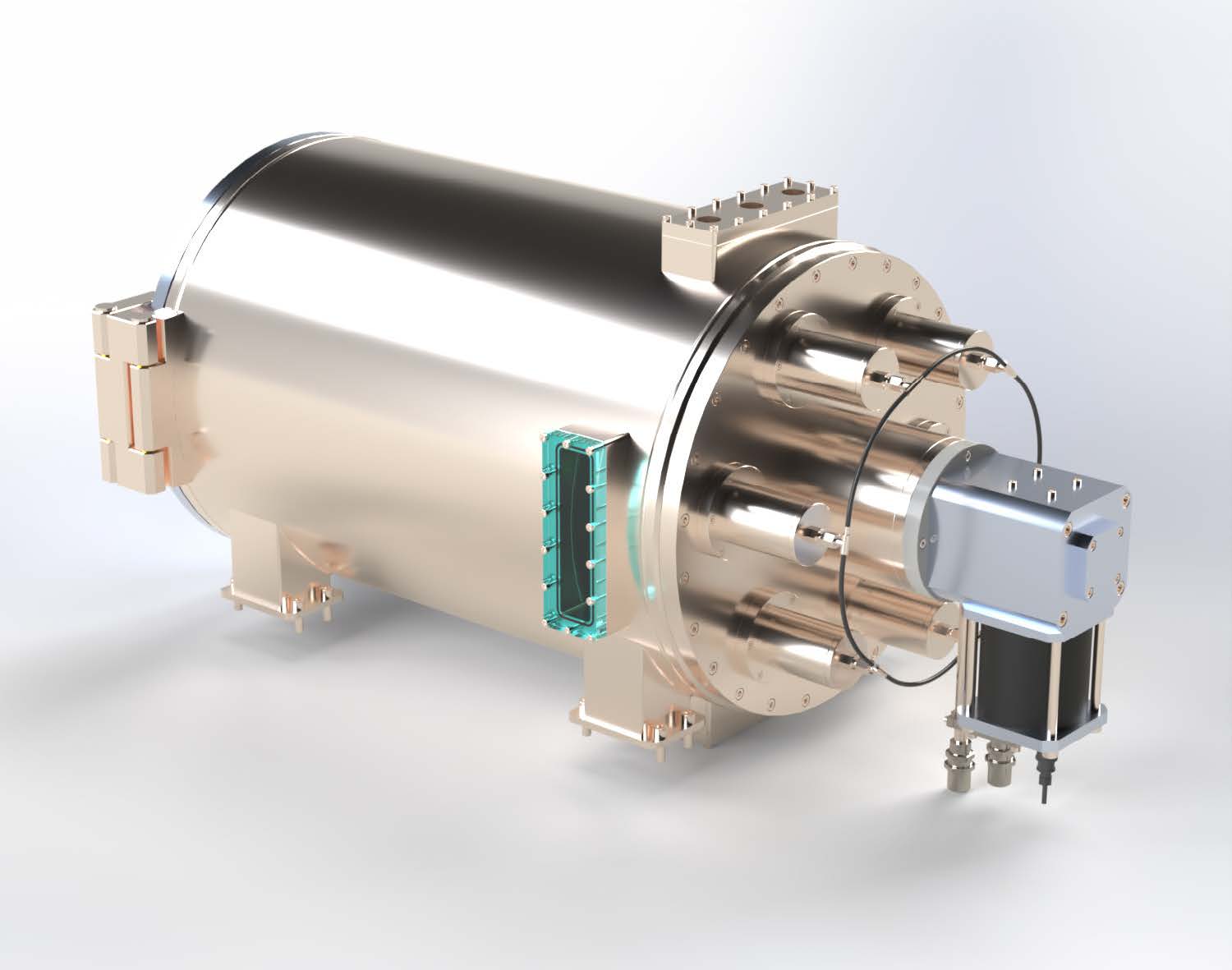

ساخت بلتفرم تشخیص دیپ فیک ها توسط شرکت Resemble AI

شرکت Resemble AI به تازگی ۱۳ میلیون دلار در یک دور جدید سرمایهگذاری استراتژیک برای تشخیص دیپفیکهای هوش مصنوعی (AI) جذب کرده و تامین مالی مجموع سرمایهگذاریهایش به ۲۵ میلیون دلار رسید.این سرمایهگذاری در شرایطی انجام میشود که سازمانها تحت فشارند تا صحت محتوای دیجیتال را تأیید کنند.

چالش هوش مصنوعی مولد

این فناوری تولید دیپفیکهای قانعکننده را برای مجرمان آسانتر کرده و درسال ۲۰۲۵ به بیش از ۱.۵۶ میلیارد دلار خسارت ناشی ازکلاهبرداری منجر شده است.

تحلیلگران بر این باورند که هوش مصنوعی مولد میتواند باعث بروز ۴۰ میلیارد دلار خسارت در زمینه کلاهبرداری در ایالات متحده تا سال ۲۰۲۷ شود.

تهدیدات جدید و ابزارهای تشخیص دیپفیک

حوادث اخیر نشان میدهد که تهدیدات به سرعت در حال تحول هستند.

در سنگاپور، ۱۳ نفر به طور مشترک بیش از ۳۶۰,۰۰۰ دلار سنگاپور را از دست دادند،

زیرا کلاهبرداران خود را به عنوان یک ارائهدهنده خدمات مخابراتی و مقام پولی سنگاپور معرفی کردند.

این حملهکنندگان از تکنیکهای مختلفی مانند جعل شناسه تماس، دیپفیک صدا و مهندسی اجتماعی استفاده کردند.

لذا احساس فوریت ایجاد کردند و از اعتماد عمومی به برندهای دولتی و مخابراتی سو استفاده کردند.

Resemble AI ابزارهای تأیید آنی را توسعه میدهد که به شرکتها درتشخیص محتوای صوتی، تصویری، متنی و دیپفیکهای تولید شده توسط هوش مصنوعی کمک میکند.

این شرکت قصد دارد از سرمایهگذاری جدید خود برای گسترش دسترسی جهانی به پلتفرم تشخیص دیپفیک هوش مصنوعی خود استفاده کند.

طبق اعلام این شرکت، DETECT-3B Omni هم اکنون در بخشهای مختلفی مانند سرگرمی، مخابرات و دولت استفاده میشود.

نتایج عمومی شاخصها در Hugging Face نشان میدهد که این مدل در بین بهترین عملکردها در زمینه تشخیص دیپفیکهای تصویری و صوتی قرار دارد.

روش جدید نرخ خطای متوسط کمتری نسبت به مدلهای رقیب دارد.

ذینفعان صنعت معتقدند که پیشرفت سریع هوش مصنوعی تولیدی نحوه تفکر شرکتها درباره اعتماد به محتوا و سیستمهای هویتی را تغییر میدهد.

نمایندگان Google’s AI Futures Fund، سونی و اوکتا اشاره کردند، سازمانها به سمت لایههای تأیید، حرکت میکنندکه میتواند به حفظ اعتماد درفرآیندهای احرازهویت کمک کند.

در کنار اعلام سرمایهگذاری، Resemble AI چشمانداز خود را درباره چگونگی تکامل خطرات مرتبط با دیپفیک در سال ۲۰۲۶ منتشر کرد.

انتظارات از پلتفرم تشخیص دیپفیک هوش مصنوعی

این شرکت انتظار دارد چندین تغییر را که میتواند بر برنامهریزی سازمانها تأثیر بگذارد، پیشبینی کند:

۱- تأیید دیپفیک ممکن است استاندارد شود.

با توجه به حوادث involving مقامات دولتی، پیشبینی میشود که تشخیص آنی دیپفیک ممکن است در نهایت برای کنفرانسهای ویدیویی رسمی الزامی شود.

۲- آمادگی سازمانی ممکن است تعیینکننده موقعیت رقابتی باشد.

بامعرفی قوانین هوش مصنوعی درمناطق مختلف، شرکتهایی که فرآیندهای آموزش، حاکمیت وانطباق را زودتر ادغام کنند، ممکن است بهتر برای تقاضاهای عملیاتی ونظارتی آماده شوند.

۳- هویت به عنوان محور اصلی امنیت هوش مصنوعی.

باتوجه به اینکه بسیاری از حملات مرتبط با هوش مصنوعی به جعل هویت وابستهاند، سازمانها ممکن است برروی مدلهای امنیتی متمرکز برهویت تأکیدبیشتری داشته باشند.

۴- افزایش هزینههای بیمه سایبری.

افزایش تعداد حوادث دیپفیک شرکتی ممکن است باعث شود که بیمهگذاران سیاستهای خود را مورد بازنگری قرار دهند.

این سرمایهگذاری ضرورت فزایندهای را برای سازمانها به منظور درک چگونگی تغییر ریسکهای ناشی از هوش مصنوعی مولد نشان میدهد.

سازمانها در تمام بخشها در حال ارزیابی این موضوع هستند که:

چگونه تأیید، حفاظت از هویت و آمادگی در برابر حوادث میتواند در استراتژیهای امنیت و انطباق گستردهتر آنها گنجانده شود.

پلتفرم تشخیص دیپفیک هوش مصنوعی، برای جلوگیری از چالش ها و خطاهای هوش مصنوعی.

منبع: یک وبلاگ تخصصی است.

ترجمه و تدوین: مهندس علیرضا کاروی، خبرنگار تخصصی پایگاه خبری پارسیان امروز

پست قبلی

پست بعدی

بارگذاری مقاله بعدی...

تازه از تنور جامعه

-

01بیماری صرع و روشهای درمان آن

01بیماری صرع و روشهای درمان آن -

02بعد از همه این حرفها،بیشتر حرف زده می شود

02بعد از همه این حرفها،بیشتر حرف زده می شود -

03فشار خون بدخیم چیست؟

03فشار خون بدخیم چیست؟ -

04در ۲۰ سال گذشته،حق آبه مردم اصفهان به تاراج رفته است

04در ۲۰ سال گذشته،حق آبه مردم اصفهان به تاراج رفته است -

05جای خالی آپارتمان برای اولین بار در ۶ سال افزایش می یابد

05جای خالی آپارتمان برای اولین بار در ۶ سال افزایش می یابد -

06کیفیت عکاسی با موبایل تا سال ۲۰۲۴ از دوربینهای DLSR هم بهتر میشود

06کیفیت عکاسی با موبایل تا سال ۲۰۲۴ از دوربینهای DLSR هم بهتر میشود -

07نیروهای آتش نشانی، اورژانس و کنترل ترافیک پالایشگاه،در کمترین زمان، بالای سر بیمار حاضرشدند

07نیروهای آتش نشانی، اورژانس و کنترل ترافیک پالایشگاه،در کمترین زمان، بالای سر بیمار حاضرشدند

برگشت به بالا

رستاخیز افضلی: ذوب بدهیها – و اینک پرواز ذوبآهن! – پایگاه خبری پارسیان امروز: […] به گزارش پارسیان امروز؛ این نشست که در تالار آهن شرکت برگزار شد، نه تنها گزارشی از دستاوردها بود، بلکه وعدهای برای بازگشت ذوبآهن به روزهای اوج تولید و سودآوری به شمار میرفت. […]

حمید صادقی: ممکن است ادامه گفتگو در این شرایط هنوز راحت نباشد ولی تا زمانی که بتوانیم به دیالوگ ادامه دهیم، در تلاشیم که به درکی از دیدگاه دیگری برسیم

کاسپین: برخی از الگوهای شخصیتی که به شکل مرسوم، روبروی هم تلقی میشوند عبارتند از: ریسکپذیرها در مقابل کسانی که محافظهکارند

محسن احمدی: موضوعاتی مثل گفتگو در مورد خانواده، سرگرمیها، فیلمها، ورزش و… از جمله این موارد هستند که عموما میتوان در دل آنها نقاط همگرایی را پیدا کرد.